De acordo com um think tank, os chatbots de IA são muito mais propensos a responder a perguntas sobre notícias de fontes de esquerda como o Guardian e a BBC.

Uma análise do Institute for Public Policy Research (IPPR), publicada hoje, revela que ferramentas populares utilizadas por milhões de pessoas se baseiam numa série de fontes “restritas e inconsistentes”.

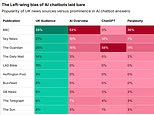

O think tank descobriu que a BBC foi a fonte mais citada nas respostas de visão geral da IA do Google, aparecendo em 52,5% das respostas, bem como a líder de mercado em confusão com 36%.

The Guardian lidera para ChatGPT e Google Gemini, com 58% e 53% das respostas aparecendo respectivamente.

Entretanto, o Daily Mail, juntamente com outras publicações de tendência mais direitista, apareceram numa pequena fracção das respostas – apesar de terem uma quota de mercado significativa do público do Reino Unido combinado.

As descobertas levantaram preocupações de que esta editorialização das empresas de IA esteja a criar uma nova geração de “vencedores e perdedores”.

Os especialistas em IPPR alertam que a selecção da fonte restringe o leque de perspectivas dos utilizadores, amplificando potencialmente pontos de vista ou agendas específicas.

Roya Powell, pesquisador sênior do IPPR, disse: “As ferramentas de IA estão rapidamente se tornando a porta de entrada para as notícias, mas neste momento essa porta é controlada por um punhado de empresas de tecnologia com pouca transparência ou responsabilidade”.

Outro fator em jogo é que regras confusas significam que as ferramentas de IA pagam e priorizam alguns canais, explorando outros conteúdos gratuitamente ou até mesmo excluindo fontes que bloqueiam o acesso.

Alguns editores, como o The Guardian, celebraram acordos de licenciamento com empresas como a ChatGPT, enquanto outros – incluindo a BBC – tentaram impedir o acesso de empresas de IA ao seu conteúdo.

O problema é agravado porque as ferramentas de IA não informam os usuários sobre por que as decisões de fornecimento são tomadas, o que significa que os usuários muitas vezes não têm ideia da edição que está acontecendo nos bastidores.

Os investigadores argumentam também que a ascensão da IA pode ter consequências graves para a sustentabilidade financeira do jornalismo de qualidade.

Por exemplo, quando uma visão geral da IA do Google está presente, os usuários do Google têm cerca de metade da probabilidade de clicar em links de notícias de editores de notícias – ameaçando a receita de publicidade e assinaturas.

Wayne Meredith, executivo-chefe da News Media Association, disse: “Como mostra o relatório, o enfraquecimento da lei de direitos autorais do Reino Unido privará os editores de recompensas e pagamentos por um jornalismo fiel que permite que a IA seja precisa e atualizada.

“A CMA deve intervir rapidamente para garantir que a Google utilize a sua posição dominante para forçar os editores a alimentar gratuitamente os seus chatbots de IA.

“Pagamentos justos por parte dos líderes de mercado são fundamentais para um mercado de licenciamento funcional e para evitar que os grandes operadores tecnológicos monopolizem a IA.”

Kirsten Jung, diretora associada de política económica e IA do IPPR, disse: “Até agora, a maior parte das políticas de IA procurou acelerar o desenvolvimento da IA.

«Mas estamos a aproximar-nos de um ponto em que precisamos de ser mais intencionais na condução da política de IA no sentido de resultados socialmente benéficos.

«No espaço noticioso, temos as ferramentas para garantir que a IA não prejudica a esfera pública e realmente melhora a qualidade e a diversidade da informação a que as pessoas têm acesso.

“Mas isso não acontecerá por si só – o governo tem que moldá-lo. Devemos aprender com o passado e moldar as tecnologias emergentes antes que seja tarde demais.”